Pe scurt:

- AMD a depășit obiectivul „30×25”, atingând o creștere de 38x a eficienței energetice la nivel de nod pentru antrenarea modelelor AI și pentru calculul de înaltă performanță (HPC). Aceasta echivalează cu o reducere de 97% a consumului de energie pentru aceeași performanță, comparativ cu sistemele de acum cinci ani.

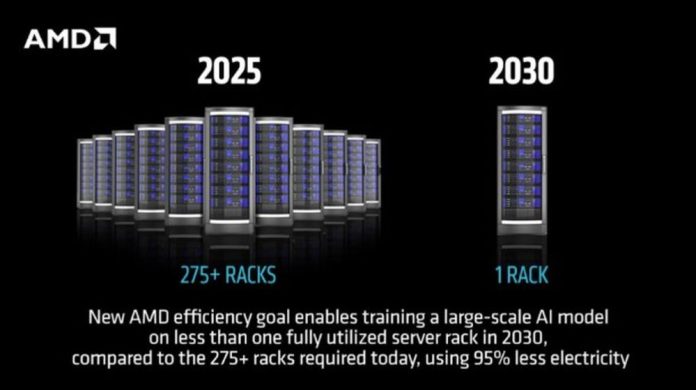

- Pentru 2030, AMD și-a propus un nou obiectiv ambițios: o creștere de 20x a eficienței energetice la nivel de rack, pornind de la nivelul de referință din 2024. Acest progres ar permite ca un model AI tipic, care astăzi necesită peste 275 de rack-uri pentru antrenare, să poată fi antrenat într-un singur rack, folosind cu 95% mai puțină energie electrică.

- Combinat cu progresele în software și algoritmi, noul obiectiv ar putea duce la o îmbunătățire totală de până la 100x a eficienței energetice.

La AMD, eficiența energetică este un principiu fundamental de proiectare. De peste un deceniu, compania și-a stabilit obiective publice, cu termene clare, pentru a crește semnificativ eficiența produselor și a reușit constant să le atingă și chiar să le depășească.

Construind un deceniu de leadership

Acesta este al treilea reper major într-un efort de decenii de a îmbunătăți eficiența platformelor de calcul. În 2020, am depășit obiectivul „25×20”, reușind să creștem eficiența energetică a procesoarelor mobile AMD de 25 de ori în doar șase ani.

Obiectivul „30×25” a continuat acest avânt, concentrându-se pe sarcinile de lucru AI și HPC în noduri accelerate.

Astăzi, ținta „20x până în 2030”, la nivel de rack, marchează următoarea frontieră — nu doar la nivel de cip, ci la nivel de sistem complet, de la siliciu până la integrarea întregului rack, pentru a răspunde cerințelor energetice tot mai mari ale centrelor de date.

Depășirea obiectivului „30×25”

Obiectivul „30×25” a avut la bază un reper clar: creșterea de 30 de ori a eficienței energetice a nodurilor de calcul accelerate, raportat la anul de referință 2020. Acest obiectiv a reprezentat o accelerare de peste 2,5 ori față de tendințele industriei din perioada 2015–2020.

Până la mijlocul anului 2025, acest prag a fost depășit, atingând o creștere de 38x față de sistemul de bază, folosind o configurație actuală formată din patru plăci grafice AMD Instinct™ MI355X și un procesor AMD EPYC™ de generația a 5-a. Aceasta se traduce printr-o reducere de 97% a consumului de energie pentru aceeași performanță, comparativ cu sistemele de acum cinci ani.

Această realizare a fost posibilă datorită unor inovații arhitecturale profunde, unei optimizări agresive a performanței per watt și îmbunătățirilor constante aduse gamei noastre de procesoare CPU și GPU.

Un nou obiectiv pentru era AI

Pe măsură ce sarcinile de lucru se dezvolta și cererea continuă să crească, câștigurile de eficiență la nivel de nod nu vor mai ține pasul. Cel mai mare impact asupra eficienței poate fi obținut la nivel de sistem, acolo unde este concentrat obiectivul companiei AMD pentru 2030.

AMD estimează că poate obține o creștere de 20 de ori a eficienței energetice la nivel de rack pentru antrenarea și inferența AI în perioada 2024–2030 – o performanță care, potrivit companiei, depășește de aproape trei ori ritmul mediu de îmbunătățire al industriei din intervalul 2018–2025. Această realizare reflectă progrese semnificative în performanța pe watt la nivelul întregului echipament – de la procesoare și acceleratoare grafice, până la memorie, rețelistică, stocare și integrarea hardware-software – toate bazate pe cele mai recente proiecte și estimări din foaia de parcurs AMD.

Tranziția de la optimizarea unui singur nod la optimizarea întregului echipament este posibilă datorită unei strategii AI end-to-end aflate într-o continuă evoluție. Această abordare este esențială pentru a susține dezvoltarea AI în centrele de date într-un mod mai eficient și sustenabil.

Ce înseamnă acest lucru în practică?

O îmbunătățire de 20x a eficienței la nivel de echipament, la aproape 3x fața de ritmul anterior al industriei, are implicații majore. Folosind antrenarea unui model AI tipic din 2025 ca reper, aceste câștiguri ar putea permite:

- Consolidarea echipamentelor de la peste 275 la mai puțin de 1 rack complet utilizat

- Reducerea cu peste 95% a consumului operațional de electricitate

- Reducerea emisiilor de carbon de la aproximativ 3.000 la 100 de tone metrice de CO₂ pentru antrenarea modelului

Aceste proiecții se bazează pe foaia de parcurs AMD pentru siliciu și proiectarea sistemelor, precum și pe o metodologie de măsurare validată de expertul în eficiență energetică, Dr. Jonathan Koomey.

„Prin ancorarea obiectivului pentru 2030 în metrici la nivel de sistem și o metodologie transparentă, AMD ridică standardul pentru industrie,” a declarat Dr. Koomey. „Câștigurile țintite în eficiența la scară rack vor permite întregului ecosistem, de la dezvoltatori de modele la furnizori de cloud, să extindă calculul AI într-un mod mai sustenabil și mai eficient din punct de vedere al costurilor.”

Dincolo de hardware

Obiectivul 20x reflectă ceea ce AMD poate controla direct: hardware-ul și proiectarea la nivel de sistem. Se pot obține câștiguri și mai mari în eficiența livrată a modelelor AI, de până la 5x în perioada obiectivului, pe măsură ce dezvoltatorii de software descoperă algoritmi mai inteligenți și continuă să inoveze cu abordări de precizie redusă. Când acești factori sunt incluși, eficiența energetică totală pentru antrenarea unui model AI tipic ar putea crește cu până la 100x până în 2030.

Deși AMD nu revendică acest multiplicator complet în obiectivul propriu, suntem mândri să oferim fundamentul hardware care îl face posibil — și să sprijinim ecosistemul deschis și comunitatea de dezvoltatori care lucrează pentru a valorifica aceste câștiguri. Fie prin standarde deschise, abordarea noastră software deschisă cu ROCm, fie prin colaborarea strânsă cu partenerii noștri, AMD rămâne dedicată sprijinirii inovatorilor din întreaga lume pentru a scala AI mai eficient.

Ce urmează?

Odată cu încheierea inițiativei 30×25 și lansarea noului obiectiv la scară de rack, ne menținem angajamentul față de transparență, responsabilitate și progres măsurabil. Această abordare este ceea ce diferențiază AMD de alți jucători din industrie și devine tot mai importantă într-un context în care cererea pentru soluții AI este în continuă creștere, iar eficiența energetică devine o prioritate.

AMD continuă să împingă limitele, nu doar în ceea ce privește performanța, ci și în ceea ce este posibil atunci când eficiența este pusă pe primul loc. Pe măsură ce se apropie de atingerea noului obiectiv, va continua să ofere actualizări despre progres și despre impactul realizărilor asupra întregului ecosistem.

- Include acceleratoare CPU și GPU de înaltă performanță utilizate pentru antrenarea AI și calcul de înaltă performanță (HPC) într-o configurație găzduită de CPU cu 4 acceleratoare. Calculele pentru obiectiv se bazează pe scoruri de performanță măsurate prin metrici standard (HPC: FLOPS pentru nucleul DGEMM Linpack cu matrice de dimensiune 4k; antrenare AI: operații matematice floating-point de precizie redusă, axate pe antrenare, folosind nuclee GEMM pe matrice 4k), împărțite la consumul de energie al unui nod de calcul accelerat reprezentativ, incluzând CPU-ul gazdă + memorie și 4 acceleratoare GPU.

- Rack-uri avansate AMD pentru antrenare/inferență AI în fiecare an (2024–2030), bazate pe foile de parcurs AMD, analizând și tendințele istorice pentru a fundamenta alegerile de design și îmbunătățirile tehnologice, aliniind obiectivele proiectate cu tendințele istorice. Rack-ul din 2024 este bazat pe nodul MI300X, comparabil cu Nvidia H100 și reflectă practica curentă în implementările AI din perioada 2024/2025. Rack-ul din 2030 este bazat pe așteptările AMD privind designul sistemului și al siliciului pentru acel interval de timp. În fiecare caz, AMD a specificat componente precum GPU-uri, CPU-uri, DRAM, stocare, răcire și comunicații, urmărind caracteristicile definite ale rack-ului pentru consumul de energie și performanță. Calculele nu includ energia pentru răcirea aerului sau a apei din afara rack-urilor, dar includ energia pentru ventilatoare și pompe interne.

Îmbunătățirile de performanță sunt estimate pe baza progresului în output-ul de calcul (FLOPS livrate și susținute, nu de vârf), lățimea de bandă a memoriei (HBM) și lățimea de bandă a rețelei (scale-up), exprimate ca indici și ponderate astfel:

| Metrică | FLOPS | Lățime bandă HBM | Lățime bandă rețea |

| Antrenare | 70.0% | 10.0% | 20.0% |

| Inferență | 45.0% | 32.5% | 22.5% |

Performanța și consumul de energie per rack implică tendințe în performanța per watt în timp pentru antrenare și inferență. Indicii pentru progresul în antrenare și inferență sunt ponderați 50:50 pentru a obține estimarea finală a progresului AMD până în 2030 (20x). Estimarea presupune progres continuu în utilizarea formatelor matematice de precizie redusă, ceea ce duce la creșterea FLOPS efective și reducerea lățimii de bandă necesare per FLOP.

- Link comunicat de presă AMD 2020

- EPYC-030a: Calculul include:

- Proiecții de utilizare kWh în 2025 realizate cu Koomey Analytics, bazate pe cercetări și date disponibile, incluzând volumele de implementare proiectate pentru 2025 și eficiența energetică a centrelor de date (PUE), inclusiv pentru instalații GPU HPC și ML.

- Consumul de energie al nodurilor CPU și GPU AMD, încorporând procente de utilizare specifice segmentului (activ vs. inactiv), înmulțite cu PUE pentru a determina consumul total de energie.

38x este calculat cu formula:

(kWhHPC2025×ı^mbuna˘ta˘țireAMDperf/WattfolosindDGEMM+TEC)+(kWhML2025×ı^mbuna˘ta˘țireAMDperf/WattfolosindMLmath+TEC)kWhtotalproiectat2025kWhtotalproiectat2025(kWhHPC2025×ı^mbuna˘ta˘țireAMDperf/WattfolosindDGEMM+TEC)+(kWhML2025×ı^mbuna˘ta˘țireAMDperf/WattfolosindMLmath+TEC)

Mai multe informații: Sustenabilitate centre de date AMD

- AMD a estimat numărul de rack-uri necesare pentru antrenarea unui model AI tipic pe baza datelor EPOCH AI (epoch.ai). Se presupune că un model tipic necesită 10251025 operații floating-point pentru antrenare (mediana datelor din 2025), desfășurată într-o lună.

FLOPs necesare=10252.6298×106 secunde/luna˘×0.6 MFUFLOPs necesare=2.6298×106 secunde/luna˘×0.6 MFU1025

Rack-uri=FLOPs necesareFLOPS/rack ıˆn 2024 și 2030Rack-uri=FLOPS/rack ıˆn 2024 și 2030FLOPs necesare

Estimările AMD sugerează că aproximativ 276 rack-uri ar fi necesare în 2025 pentru a antrena un model tipic într-o lună folosind MI300X (22.656 PFLOPS/rack, MFU 60%), iar <1 rack complet utilizat ar fi necesar în 2030.

Consumul de energie pentru antrenarea completă a modelului în 2024 este de ~7 GWh, iar în 2030 ar fi ~350 MWh, o reducere de 95%.

Emisiile de carbon:

- 2024: 7 GWh × 434 g CO₂/kWh ≈ 3000 tCO₂

- 2030: 350 MWh × 312 g CO₂/kWh ≈ 100 tCO₂

- Analiza regresivă a acurateței/parametru pentru modele de referință (MMLU, HellaSwag, ARC Challenge) arată că tehnici algoritmice noi (ex. Mixture of Experts, State Space Models) pot îmbunătăți eficiența cu aproximativ 5x în perioada obiectivului.

Referință:

Patterson, D. et al. (2022). The Carbon Footprint of Machine Learning Training Will Plateau, Then Shrink. Computer, vol. 55, nr. 7, pp. 18–28.

Prin urmare, presupunând că inovația continuă în același ritm, un obiectiv hardware și de design de sistem de 20x, amplificat de progrese software și algoritmice de 5x, poate duce la un câștig total de 100x până în 2030.