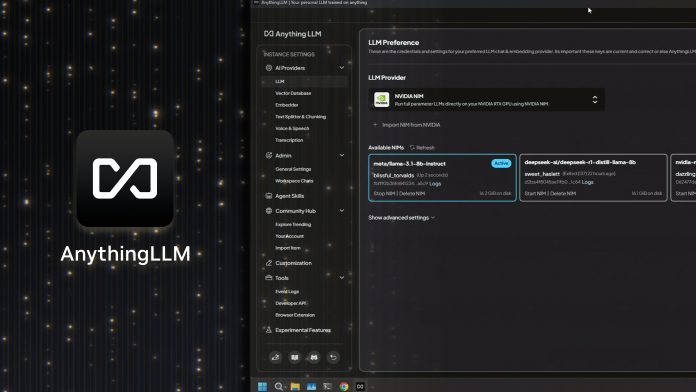

Posibilitatea de a rula LLM-uri local nu mai este doar pentru anumiți utilizatori pentru că AnythingLLM face acest lucru mai simplu și mai rapid pe plăcile video RTX.

Săptămâna aceasta în RTX AI Garage blog explorăm cum AnythingLLM, o aplicație de desktop open-source pentru fluxuri de lucru AI locale simplifică rularea de LLM-uri, sisteme RAG și unelte agentic pentru dezvoltatori și entuziaști direct pe dispozitivele lor, fără a fi nevoie de cloud sau instalări complexe.

Cu suport adăugat pentru microserviciile NVIDIA NIM, AnythingLLM oferă utilizatorilor o metodă mai usoară și mai rapidă de a rula modele de AI generativ local. NIM-urile sunt pre-făcute și optimizate pentru plăcile video RTX și elimină nevoia de a trece prin procese manuale. Este o metodă plug-and-play prin care poți începe cu GenAI și un pas clar în dezvoltarea AI locală mai accesibilă.

De ce contează:

- Viteză: Pe un GeForce RTX 5090, performanța unui LLM local este de 2.4x mai rapidă decât pe Apple M3 Ultra datorită accelerării de la nucleele Tensor și a Ollama + Llama.cpp + GGML stack.

- Confidențialitate: Toate datele și modelele sunt locale, un plus semnificativ pentru dezvoltatorii care lucrează cu conținut brevetat, fișiere personale sau fluxuri de lucru private.

- Simplicitate: AnythingLLM oferă un UI simplu și instalare printr-un singur click, iar împreună cu NIM elimină overhead-ul standard de lucrat cu LLM-uri pe dispozitiv.

Postarea de blog arată și cum utilizatorii combină AnythingLLM cu NVIDIA AI Blueprints pentru a extinde și încerca fluxuri de lucru multi-modale – de la chatbots și analiză de date și până la automatizare agentic, toate pe PC-uri alimentate RTX.