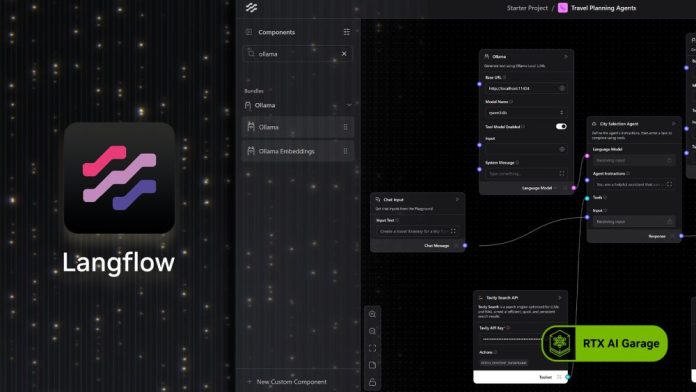

În această săptămână, RTX AI Garage prezintă modul în care pasionații de inteligență artificială utilizează aplicații populare precum Langflow, o platformă vizuală, low-code, pentru crearea de fluxuri de lucru AI personalizate utile pentru conectarea modelelor generative de AI într-un mod intuitiv.

Datorită integrării native cu Ollama, utilizatorii pot acum crea fluxuri de lucru AI locale, care rulează gratuit și cu confidențialitate completă, susținute de plăcile grafice NVIDIA GeForce RTX și RTX PRO.

-

Confidențialitatea datelor: toate intrările, fișierele și comenzile rămân stocate pe dispozitiv.

-

Costuri reduse și fără AP keys: deoarece nu este necesar accesul la interfețe API în cloud, nu există restricții precum tokenii, abonamente la servicii sau alte costuri asociate rulării modelelor AI.

-

Performanță superioară: GPU-urile RTX asigură inferență cu latență redusă și randament ridicat, chiar și în cazul prompturilor lungi.

-

Funcționare offline: fluxurile AI locale pot fi utilizate fără conexiune la internet.

De asemenea, utilizatorii pot controla acum PC-urile RTX AI folosind Project G-Assist direct în Langflow.

NVIDIA Project G-Assist, asistentul AI experimental, care rulează local pe PC-urile GeForce RTX le permite utilizatorilor să ceară informații despre sistem, să ajusteze setări și multe altele, totul prin comenzi simple într-un limbaj natural.

Prin componenta G-Assist integrată în Langflow, aceste funcționalități pot fi incluse în fluxuri de lucru autonome personalizate. Utilizatorii pot introduce comenzi precum „obține temperatura GPU-ului” sau „reglează viteza ventilatoarelor”, iar răspunsurile și acțiunile G-Assist se vor integra perfect în lanțul de componente al fluxului.